腾讯正式开源金融大模型专项评测方案finLLM-Eval,首次提出无GroundTruth下的金融数据准确性评测方法,为高风险的金融AI应用建立可靠性屏障。

项目核心价值:专攻金融场景的"AI质检员"

2026年1月,腾讯开源宣布推出finLLM-Eval,这是一套针对金融行业特殊需求定制的大模型幻觉评测方案。该项目旨在解决金融AI应用中最棘手的"幻觉"问题:即模型生成内容与客观事实不符或存在逻辑漏洞的现象。

金融行业具有高专业、强合规、低容错的核心特性,对数据准确性要求极为苛刻。传统大模型评测方法难以满足金融场景的特殊需求,而finLLM-Eval的推出填补了这一空白。该项目已在GitHub平台开源,提供完整的评测框架和示例数据集。

技术架构:三大评测模块构建完整体系

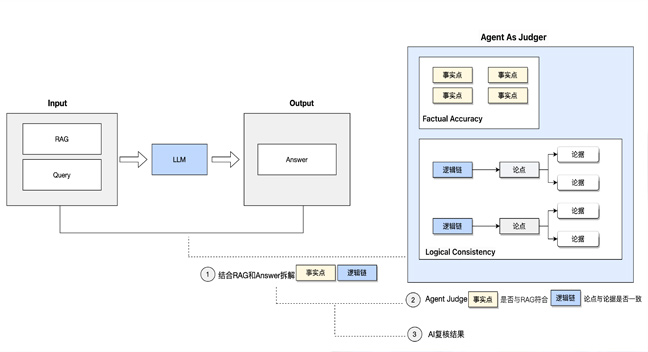

1、逻辑一致性与事实准确性评测

该模块通过Agent As Judger模式,自动提取模型回答中的事实点和逻辑链,与提供的RAG内容进行比对。系统能够识别金融分析中的逻辑谬误,确保投资建议符合市场规律。

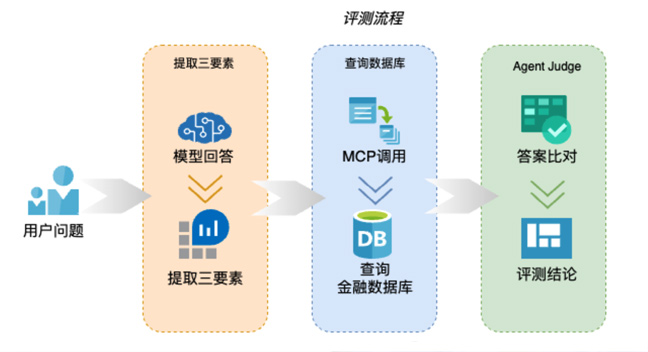

2、无GroundTruth金融数据准确性评测

这是项目的最大创新点。系统从模型回答中自动提取"标的×时间×指标"三要素,通过内部金融数据库进行自动化验证,无需人工标注标准答案。这种方法大幅降低了评测成本,提高了效率。

3、端到端应用评测能力

针对实际部署的金融AI应用,finLLM-Eval支持基于真实用户问答的端到端评测,能够模拟真实业务场景下的模型表现。

创新突破:破解金融AI落地核心痛点

行业首创的无GroundTruth评测方案使得金融机构能够在缺乏标准答案的情况下,依然能够对模型输出进行有效性验证。这一突破对投资分析、风险评估等复杂场景尤为重要。

评测系统采用多层级验证机制,首先由初级Agent进行事实点和逻辑链的提取与初判,再由LLM进行二次复核,确保评测结果的准确性。腾讯内部测试显示,该方案的准确率高达96%以上。

项目还提供了全面的量化指标,包括千字幻觉率、错误点分布等关键数据,为模型优化提供明确方向。

应用场景:覆盖金融AI全链路需求

finLLM-Eval适用于多种金融AI应用场景:

投研分析:确保研报中的金融数据准确无误,逻辑推理严谨可靠;

智能投顾:验证投资建议的合理性和合规性;

风险控制:检测模型在信贷评估、欺诈识别等场景中的可靠性;

监管合规:帮助金融机构满足日益严格的AI监管要求。

开源生态与未来发展

腾讯此次开源的是完整评测框架,包括逻辑一致性与事实准确性评测模块的完整工程代码、示例评测集及相关工具。虽然端到端金融数据准确性对比模块涉及内部金融数据库暂未开放,但项目提供了详细的技术方案文档。

项目团队表示,未来将持续迭代finLLM-Eval,计划支持非金融指标数据核验、结果归因等能力,进一步扩大其应用范围。

行业影响分析:推动金融AI从"可用"到"可靠"

finLLM-Eval的出现,标志着金融AI行业开始建立标准化评测体系。长期以来,金融机构对大模型应用持谨慎态度,主要原因就是缺乏可靠的质量保障机制。该项目的开源将促进整个行业建立统一的质量标准。

对于金融机构而言,这一工具大幅降低了AI应用的试错成本。传统金融AI项目需要大量人工复核来确保输出质量,而现在可以通过自动化评测快速发现问题,加速模型迭代优化。

从技术发展角度看,finLLM-Eval为其他高风险行业的AI应用提供了可借鉴的评测范式。医疗、法律等同样对准确性要求极高的领域,可以基于这一思路开发各自的专项评测方案。

随着AI在金融领域的深入应用,可靠性评测将成为与模型训练同等重要的环节。腾讯此次开源不仅展现了技术实力,更体现了对AI负责任发展的承诺,为行业健康发展注入新的动力。