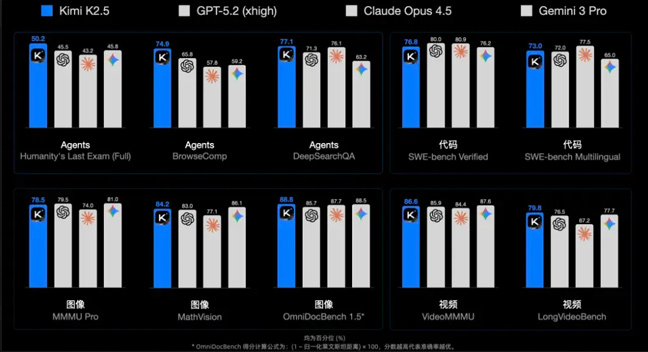

月之暗面(Moonshot AI)今日正式推出Kimi K2.5多模态模型,该模型在代码生成、视觉理解及长上下文处理能力上实现显著提升。作为Kimi系列迄今最智能的版本,K2.5采用原生多模态架构,同步支持视觉与文本输入,并兼容思考与非思考模式。根据官方技术文档,模型总参数量达800亿,激活参数约130亿,在Agent任务、代码生成等开源基准测试中达到当前最优水平(SoTA)。

Kimi K2.5在前端代码生成领域实现突破性进展。模型可依据自然语言指令直接生成具备动态布局、滚动动画等复杂交互效果的完整界面代码,其输出代码在视觉表现力与功能完整性上较前代提升显著。同时,模型继续支持256K超长上下文窗口,在处理长文档分析、多轮对话等场景时保持稳定性。

思考能力(Thinking Mode)成为K2.5的核心竞争力之一。模型支持多步工具调用与复杂逻辑推理,在数学问题求解、代码调试等需深度思考的任务中表现突出。用户可通过API参数控制思考模式的启用与关闭,满足不同场景下的响应速度需求。

模型支持图像与视频的双模态理解,可处理PNG、JPEG、MP4、MOV等十余种主流格式。通过动态Token计算机制,系统根据输入内容的分辨率与复杂度自动调整资源分配。官方推荐图片分辨率不超过4K,视频分辨率不超过2K,以平衡处理效率与识别精度。

目前,开发者可通过完全兼容OpenAI格式的API接口调用K2.5模型,支持Base64编码或文件上传两种输入方式。针对大规模视频文件,系统强制要求使用文件上传接口以避免请求体过量。

多模态模型竞争近期持续升温。百度文心大模型4.0已支持工业级图像生成,阿里巴巴通义万相聚焦电商场景的素材创作,而字节跳动豆包则强化了视频理解与剪辑辅助功能。据IDC最新报告,2025年中国多模态AI市场规模同比增长达92%,代码生成与视觉理解成为企业级应用的核心需求。

在定价策略上,Kimi K2.5的输入Token费用为每百万Token 0.7元(缓存命中)至4元(缓存未命中),输出Token费用为每百万Token 21元,与国际主流模型保持相近水平。

月之暗面(Moonshot AI)在发布Kimi K2.5模型的同时,正式推出新一代开发者工具Kimi Code。该工具突破传统命令行工具的局限,通过终端IDE深度集成与智能技能迁移机制,实现开发效率的范式级提升。目前Kimi Code已开源,支持VSCode、Cursor、Zed等主流IDE,并兼容图像、视频等多模态输入。

Kimi Code在终端中提供类Shell的交互体验,允许开发者通过自然语言描述任务需求,如“帮我看一下这个项目的目录结构”或“实现用户登录功能”。工具采用动态模式切换机制,支持在自然语言对话与直接命令执行间即时转换。当用户输入以“/”开头的命令时自动切换至Shell模式,输入自然语言时则激活AI交互模式,无需手动切换上下文。

值得注意的是,工具内置项目感知能力。开发者通过“/init”命令可自动生成AGENTS.md文件,帮助AI理解项目结构、技术栈及编码规范。在内部测试中,该功能使陌生代码库的熟悉时间缩短约70%。

Kimi Code突破性地实现现有技能生态的无缝迁移。系统可自动发现本地已安装的MCP(Model Context Protocol)工具链,并将其集成至工作环境。例如,当检测到用户已配置Git、Docker或自定义脚本时,会自动将这些工具的能力映射至Kimi Code的智能调度系统。

这一机制显著降低AI工具的使用门槛。开发者无需重新学习工具调用方式,即可通过自然语言指令调用现有工具链,如“用Docker部署当前项目”或“运行测试并生成覆盖率报告”。官方演示案例显示,Kimi Code成功将马蒂斯画作《舞蹈》的美学风格转化为网页设计,全程仅通过自然语言指令完成视觉调试、代码生成和样式优化。

依托K2.5的多模态能力,Kimi Code支持开发者直接上传界面设计稿或功能演示视频,自动生成对应代码。在演示案例中,通过分析网站录屏视频,工具成功重构了完整的前端界面,包括滚动动画和交互逻辑。这种“视觉到代码”的能力大幅降低了原型开发的门槛。

AI编程工具正迎来生态整合浪潮。GitHub Copilot Workspace新增团队协作功能,Amazon CodeWhisperer强化云端开发场景适配,而国内厂商如阿里、百度也相继推出集成IDE的智能编程助手。据Gartner预测,到2027年,40%的企业开发项目将采用AI原生工具链。