智谱AI今日正式发布并开源GLM-4.7-Flash模型,这款总参数量30B、激活参数量3B的混合思考模型,以同级别SOTA表现宣告轻量化AI模型进入新阶段。即日起,该模型在智谱开放平台BigModel.cn上线并供免费调用,直接替代前代GLM-4.5-Flash模型。

技术突破:混合思考架构实现性能与效率平衡

GLM-4.7-Flash采用创新的混合思考模式,在保持30B总参数量的同时,通过仅激活3B参数实现推理计算,这一设计使得模型在保持强大能力的基础上大幅提升计算效率。200K的上下文窗口和128K的最大输出Tokens,为长文本处理提供充足空间。

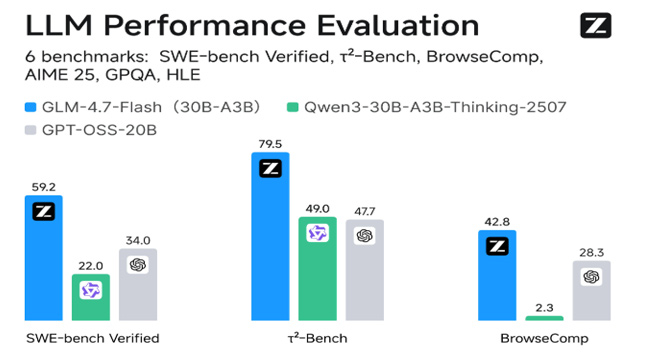

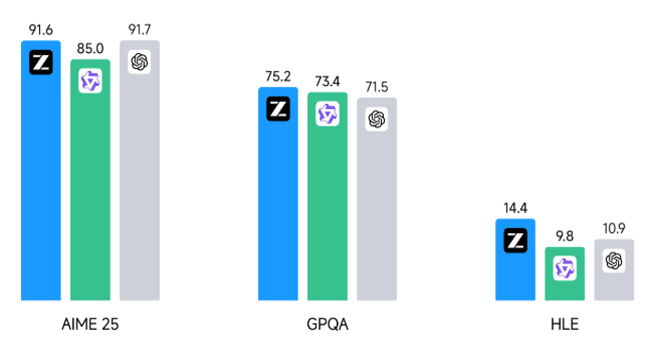

在权威基准测试中,GLM-4.7-Flash表现卓越。在SWE-bench Verified和τ²-Bench等主流测试中,其综合表现超越gpt-oss-20b、Qwen3-30B-A3B-Thinking-2507等竞争对手,在相同和近似尺寸模型系列中取得开源SOTA分数。

功能特性:面向实际应用场景的全面优化

新模型在多个维度实现显著提升。深度思考模式支持复杂问题的逐步推理,流式输出确保实时交互体验,而强大的Function Call能力为外部工具集成提供便利。结构化输出和上下文缓存功能进一步优化了长对话场景下的性能表现。

特别值得关注的是,GLM-4.7-Flash在Agentic Coding场景实现重大突破。模型能够从目标描述出发,自主完成需求理解、方案拆解与多技术栈整合,在包含前后端联动、实时交互的复杂场景中,可直接生成结构完整、可运行的代码框架。

应用场景:从代码开发到内容创作的全方位覆盖

智谱AI官方推荐GLM-4.7-Flash在多个场景中发挥价值。在编程开发领域,模型展现出卓越的前后端开发能力;在创意内容方面,其沉浸式写作与角色驱动创作能力可生成更具画面感的文字表达;办公场景中,模型能稳定适配主流比例,生成接近"即用级"的PPT和海报设计。

对于智能搜索与深度研究任务,GLM-4.7-Flash强化了用户意图理解和信息检索能力,不仅能返回信息,还能进行结构化整理与跨来源整合,通过多轮交互持续逼近核心结论。

生态布局:免费策略加速开发者采用

根据官方规划,上一代免费语言模型GLM-4.5-Flash将于2026年1月30日下线,相关请求将自动路由至GLM-4.7-Flash。这一无缝迁移策略确保开发者体验的连续性,同时享受新一代模型的性能提升。

智谱AI为开发者提供完善的接入支持,包括详细的API文档和多种编程语言的SDK。平台提供体验中心供开发者快速测试模型效果,降低集成门槛。

行业影响:轻量化模型市场竞争加剧

GLM-4.7-Flash的发布,标志着轻量化AI模型赛道竞争进入新阶段。其开源策略不仅降低企业使用门槛,更将推动整个开发者生态的繁荣。在AI模型日益大型化的背景下,智谱AI通过精准的参数控制和架构优化,证明轻量化模型同样能在特定场景下实现卓越表现。

随着模型正式开源,开发者社区可基于GLM-4.7-Flash进行二次开发和优化,进一步拓展其应用边界。这一举措有望在AI应用落地浪潮中培育出新的创新生态。

业内专家认为,GLM-4.7-Flash的推出将加速AI技术在实际业务场景中的普及,特别是在中小企业和个人开发者群体中。其免费调用政策更显诚意,预计将吸引大量开发者从实验性尝试转向实际业务部署。